VARIEDADES MEJORADAS

Se busca resolver las carencias de un conocimiento integral que abarque las interacciones biológicas, genéticas y moleculares que subyacen a la respuesta de la palma ante condiciones adversas, así como en el conocimiento de los agentes patogénicos en los niveles ya expuestos.

Conocer más

USOS DEL ACEITE

Calidad del aceite, Valor agregado, Salud y nutrición humana

Conocer másEXTENSIÓN Y CAPACITACIÓN

ACTUALIDAD

XVII Reunión Técnica Nacional de Palma de Aceite 29 de septiembre al 1 de octubre de 2021 Innovación, sostenibilidad y bienestar para Colombia

Ver más

Publicaciones

Polioles grasos: Producción, retos y oportunidades para el sector del aceite de palma

Ver más

Polioles grasos: Producción, retos y oportunidades para el sector del aceite de palma

Ver más

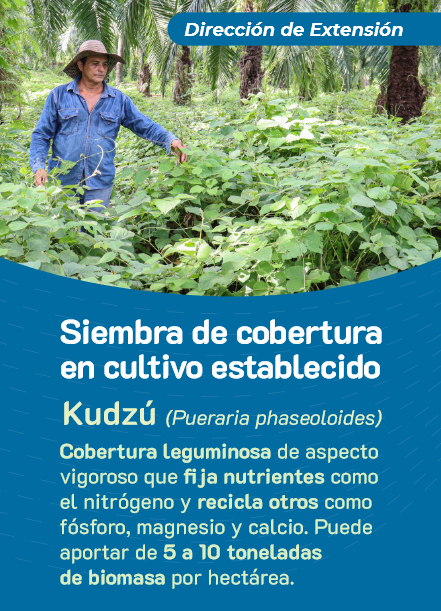

Siembre de cobertura en cultivo establecido

Ver más

Siembre de cobertura en cultivo establecido

Ver más

Resumen Ejecutivo: Resultados por líneas de investigación y extensión 2021

Ver más

Resumen Ejecutivo: Resultados por líneas de investigación y extensión 2021

Ver más

Infografía: Opsiphanes invirae puede comerse su inversión

Ver más

Infografía: Opsiphanes invirae puede comerse su inversión

Ver más

Evaluación de calidad de las aspersiones en cultivos de palma de aceite

Ver más

Evaluación de calidad de las aspersiones en cultivos de palma de aceite

Ver más

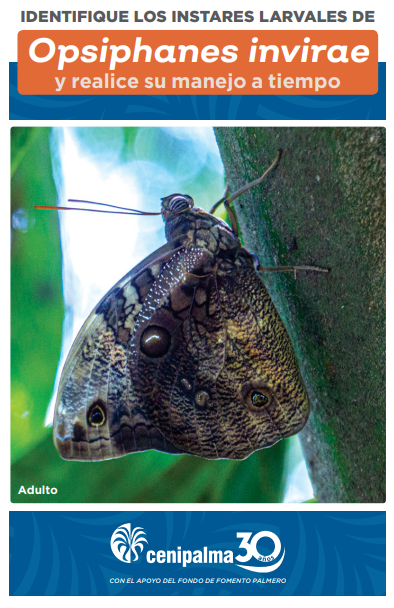

Foto: Identifique los instares larvales de Opsiphanes invirae y realice su manejo a tiempo

Ver más

Foto: Identifique los instares larvales de Opsiphanes invirae y realice su manejo a tiempo

Ver más

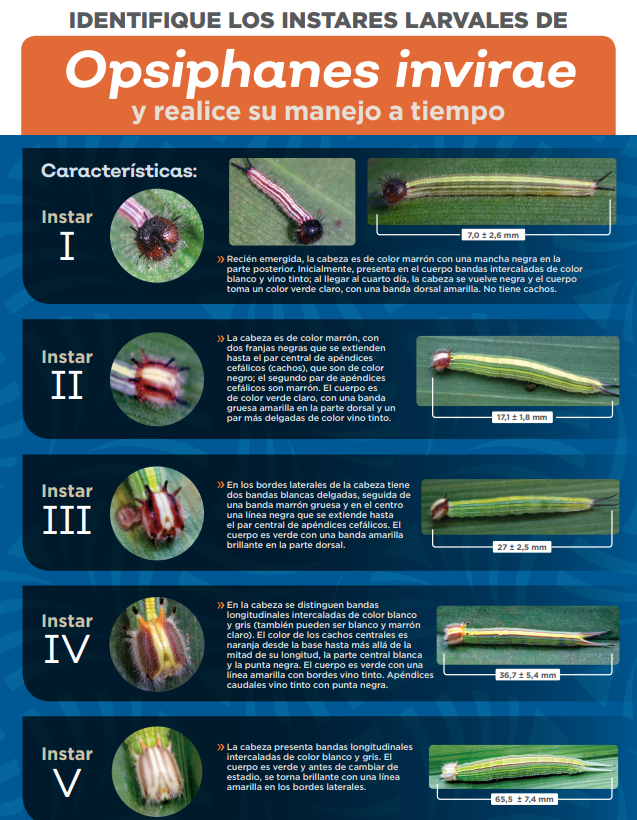

Afiche: Identifique los instares larvales de Opsiphanes invirae y realice su manejo a tiempo

Ver más

Afiche: Identifique los instares larvales de Opsiphanes invirae y realice su manejo a tiempo

Ver más

Libro: Cenipalma tres décadas de investigación y extensión al servicio de los palmicultores

Ver más

Libro: Cenipalma tres décadas de investigación y extensión al servicio de los palmicultores

Ver más

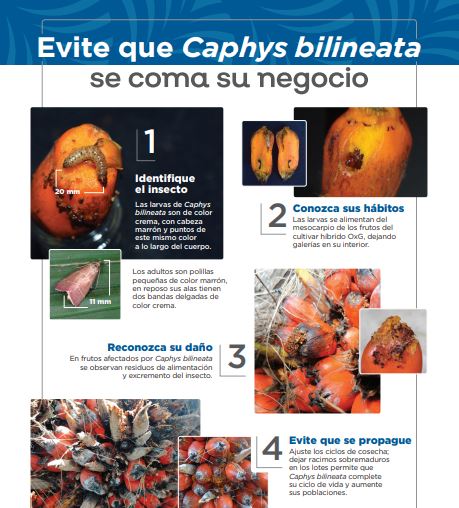

Afiche: Evite que Caphys bilineata se coma su negocio

Ver más

Afiche: Evite que Caphys bilineata se coma su negocio

Ver más

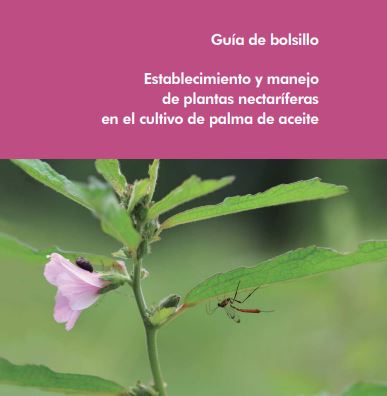

Guía de bolsillo: Establecimiento y manejo de plantas nectaríferas en el cultivo de palma de aceite

Ver más

Guía de bolsillo: Establecimiento y manejo de plantas nectaríferas en el cultivo de palma de aceite

Ver más

Boletín Técnico N° 40: Referenciación competitiva al proceso de polinización artificial en cultivares híbridos interespecíficos OxG: Coari x La Mé

Ver más

Boletín Técnico N° 40: Referenciación competitiva al proceso de polinización artificial en cultivares híbridos interespecíficos OxG: Coari x La Mé

Ver más

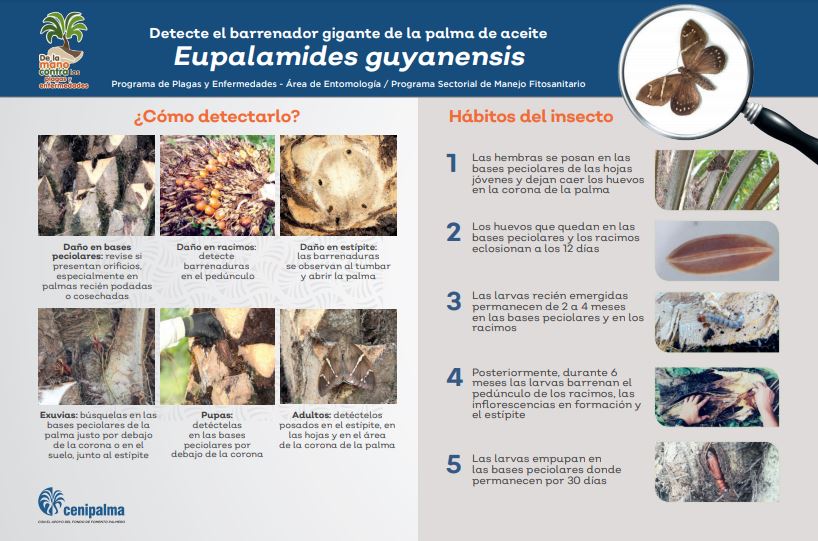

Infografía Eupalamides Guyanensis

Ver más

Infografía Eupalamides Guyanensis

Ver más

Cartilla Aspectos básicos para el conocimiento de sistemas de drenajes y su mantenimiento

Ver más

Cartilla Aspectos básicos para el conocimiento de sistemas de drenajes y su mantenimiento

Ver más

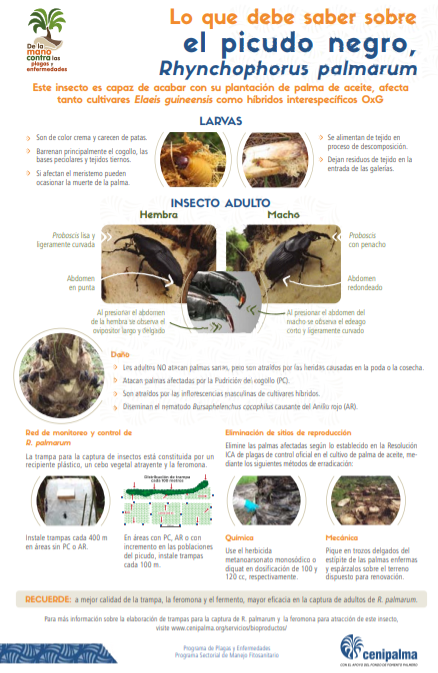

Infografía Lo que debe saber sobre el picudo negro

Ver más

Infografía Lo que debe saber sobre el picudo negro

Ver más

Brochure Rhynchophorus palmarum

Ver más

Brochure Rhynchophorus palmarum

Ver más

Afiche identificación y control del picudo negro

Ver más

Afiche identificación y control del picudo negro

Ver más

Guía de bolsillo reconocimiento de síntomas y estrategias de manejo de pudriciones de estípite

Ver más

Guía de bolsillo reconocimiento de síntomas y estrategias de manejo de pudriciones de estípite

Ver más

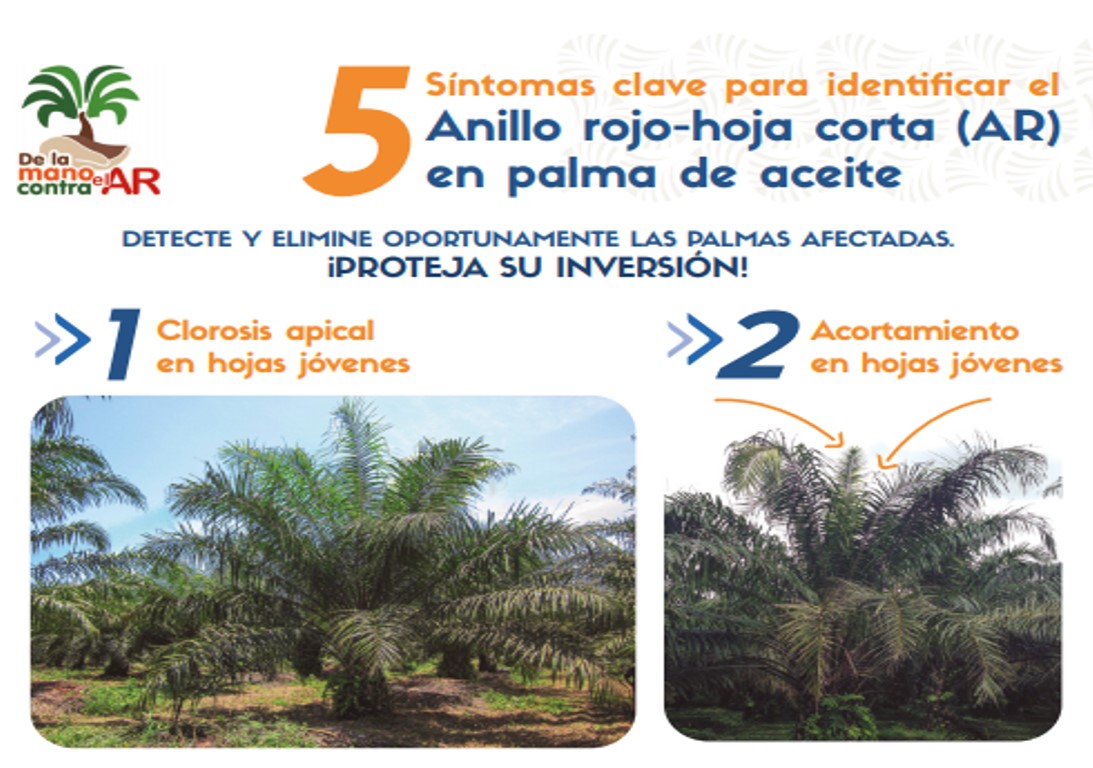

5 síntomas clave para identificar el Anillo rojo-hoja corta en palma de aceite

Ver más

5 síntomas clave para identificar el Anillo rojo-hoja corta en palma de aceite

Ver más

4 razones para sembrar y mantener nectaríferas en su plantación de palma de aceite

Ver más

4 razones para sembrar y mantener nectaríferas en su plantación de palma de aceite

Ver más

Detección y manejo de palmas afectadas por Anillo rojo-hoja corta AR en palma de aceite

Ver más

Detección y manejo de palmas afectadas por Anillo rojo-hoja corta AR en palma de aceite

Ver más

Infografía ¿Por qué el aceite de palma puede formar parte de una alimentación saludable?

Ver más

Infografía ¿Por qué el aceite de palma puede formar parte de una alimentación saludable?

Ver más

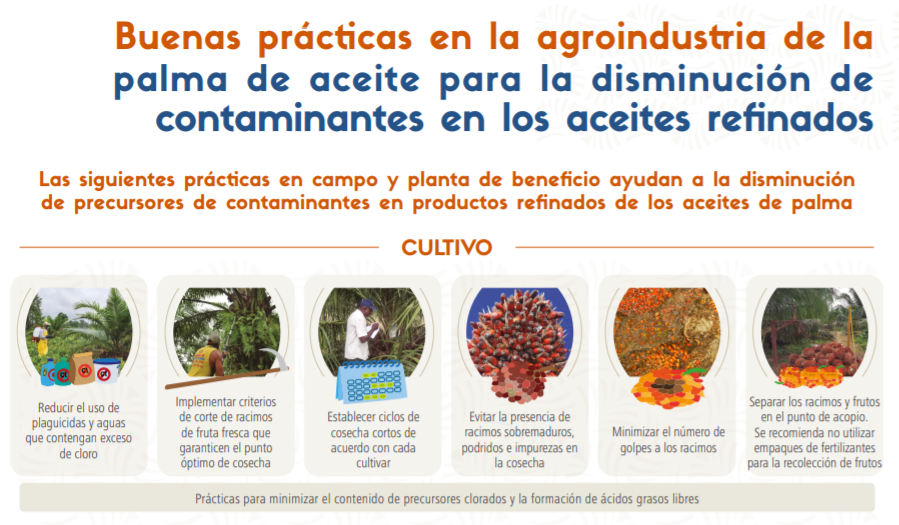

Afiche Buenas prácticas en la agroindustria de la palma de aceite para la disminución de compuestos contaminantes en aceites refinados

Ver más

Afiche Buenas prácticas en la agroindustria de la palma de aceite para la disminución de compuestos contaminantes en aceites refinados

Ver más

Cartilla Calibración de equipos de aspersión en el cultivo de palma de aceite

Ver más

Cartilla Calibración de equipos de aspersión en el cultivo de palma de aceite

Ver más

Ceniavances Edición especial - Líneas Estratégicas de Investigación y Extensión de Cenipalma: el Nuevo Enfoque de Trabajo Articulado

Ver más

Ceniavances Edición especial - Líneas Estratégicas de Investigación y Extensión de Cenipalma: el Nuevo Enfoque de Trabajo Articulado

Ver más

Afiche Identifique los criterios de calidad en tolva para racimos de fruto de palma de aceite en cultivares híbridos OxG

Ver más

Afiche Identifique los criterios de calidad en tolva para racimos de fruto de palma de aceite en cultivares híbridos OxG

Ver más

Afiche Sintomatología de la Pudrición Seca del Estípite (PSE) de la palma de aceite

Ver más

Afiche Sintomatología de la Pudrición Seca del Estípite (PSE) de la palma de aceite

Ver más

Afiche Sintomatología de la Pudrición Húmeda del Estípite (PHE) de la palma de aceite

Ver más

Afiche Sintomatología de la Pudrición Húmeda del Estípite (PHE) de la palma de aceite

Ver más

Afiche Sintomatología de la Pudrición Basal del Estípite (PBE) de la palma de aceite

Ver más

Afiche Sintomatología de la Pudrición Basal del Estípite (PBE) de la palma de aceite

Ver más

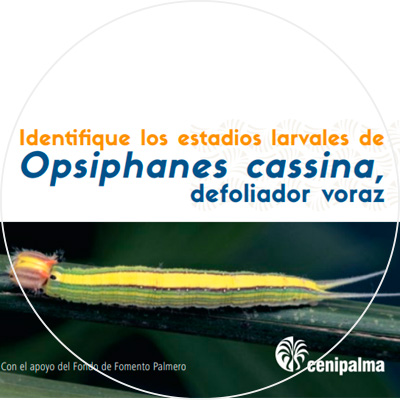

Afiche Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Afiche Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Infografía Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Infografía Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Folleto Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Folleto Identifique los estadios larvales de Opsiphanes cassina, defoliador voraz

Ver más

Guía de Bolsillo Loxotoma elegans y sus enemigos naturales

Ver más

Guía de Bolsillo Loxotoma elegans y sus enemigos naturales

Ver más

Cartilla Mejores prácticas laborales y mecanismos de contratación

Ver más

Cartilla Mejores prácticas laborales y mecanismos de contratación

Ver más

Cartilla Mejores prácticas en nutrición y cosecha

Ver más

Cartilla Mejores prácticas en nutrición y cosecha

Ver más

Infografía 4 razones para sembrar y mantener nectaríferas en su plantación de palma de aceite

Ver más

Infografía 4 razones para sembrar y mantener nectaríferas en su plantación de palma de aceite

Ver más

Infografía 5 síntomas clave para identificar el Anillo rojo-hoja corta en palma de aceite

Ver más

Infografía 5 síntomas clave para identificar el Anillo rojo-hoja corta en palma de aceite

Ver más

Centro de Información y Documentación Palmero

Ver más

Centro de Información y Documentación Palmero

Ver más